[xParser] Парсер RSS лент

Парсер контента RSS лент, с возможностью скачивания медиа-контента на сайт.

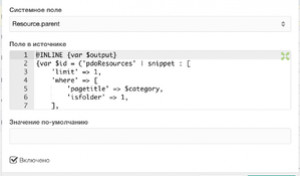

При добавлении полей ленты, которые надо парсить, вместо названия поля (title или enclosure[url]) можно указать @INLINE чанк, который будет обработан Fenom. Благодаря этому, в этих полях можно выстраивать совершенно любую логику, вплоть до создания новых разделов «на ходу».

Стояла задача, как можно больше упростить взаимодействие с компонентом, поэтому жду мнений, насколько компонент прост в управлении.

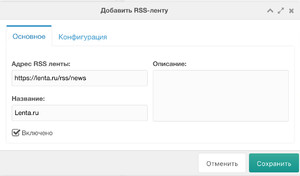

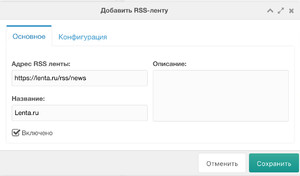

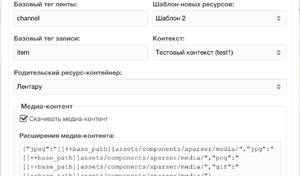

На вкладке Основное заполняем примерно так:

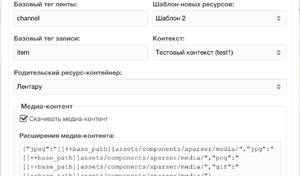

Переключаемся на вкладку Конфигурация, где можно указать:

Расширения медиа-контента и папки для сохранения каждого из расширений указываются в JSON.

Жмём Сохранить — задание добавлено!

Откроется список полей задания, который пока пуст.

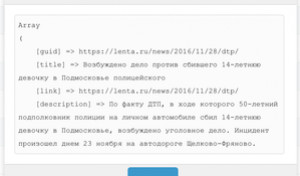

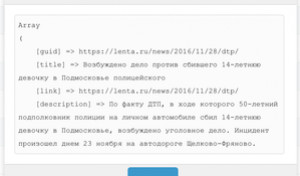

Помимо добавления полей задания мы можем просмотреть Массив значений ленты — это распечатанный массив с данным из первой записи ленты:

Запоминаем названия полей, которые нам надо парсить на сайт и кликаем Добавить поле. Откроется окошко с возможностью указать:

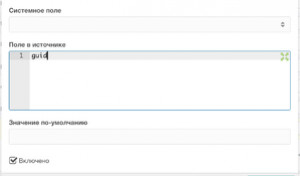

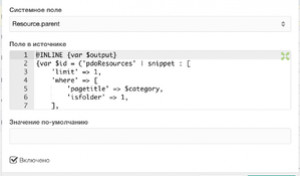

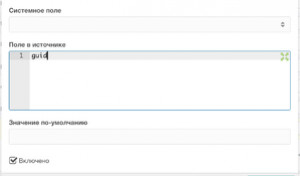

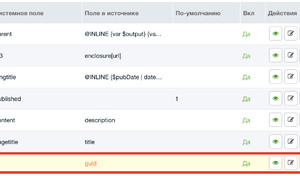

Помимо основых полей с данными, которые необходимо выгрузить на сайт, нам надо ещё добавить поле, по которому пакет будет понимать, что данная запись уже есть на сайте. Для этого добавляем новое поле, значение Системное поле оставляем пустым, а в Поле в источнике пишем, например, «guid» (потому что он менее всего подвержен изменениям). Должно быть как-то так:

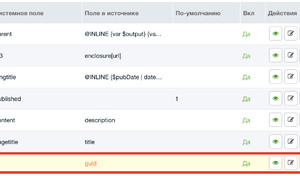

Сохраняем. В списке полей на этом поле ставим указатель Уникальное поле (кнопка со звездой слева):

Всё готово к парсингу, как к единоразовому, так и к ежеминутному (у компонента есть скрипт для запуска заданий из крона).

Спасибо Владимиру за спонсорскую поддержку!

P.S. Владимиру этим компонентом, даже, как-то удавалось запускать импорт из WordPress в MODX. Надеюсь, он нам расскажет, как это сделать.

При добавлении полей ленты, которые надо парсить, вместо названия поля (title или enclosure[url]) можно указать @INLINE чанк, который будет обработан Fenom. Благодаря этому, в этих полях можно выстраивать совершенно любую логику, вплоть до создания новых разделов «на ходу».

Подробнее о работе

Стояла задача, как можно больше упростить взаимодействие с компонентом, поэтому жду мнений, насколько компонент прост в управлении.

Добавляем задание

Заходим на страницу компонента, жмём Добавить задание => Добавить RSS-ленту.На вкладке Основное заполняем примерно так:

Переключаемся на вкладку Конфигурация, где можно указать:

- Шаблон для создаваемых ресурсов,

- Контекст,

- Родительский контейнер в пределах выбранного контекста,

- Сконфигурировать скачивание медиа-контента,

- При необходимости поменять базовый тег ленты и базовый тег записи.

Расширения медиа-контента и папки для сохранения каждого из расширений указываются в JSON.

Жмём Сохранить — задание добавлено!

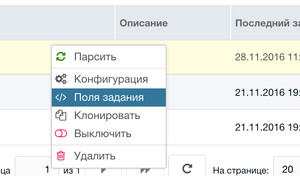

Добавляем поля для парсинга

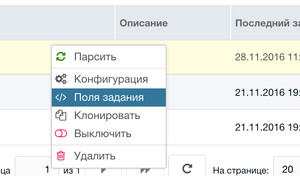

На только что добавленном задании нажимаем правой кнопкой и выбираем Поля задания:

Откроется список полей задания, который пока пуст.

Помимо добавления полей задания мы можем просмотреть Массив значений ленты — это распечатанный массив с данным из первой записи ленты:

Запоминаем названия полей, которые нам надо парсить на сайт и кликаем Добавить поле. Откроется окошко с возможностью указать:

- Системное поле. Выпадающий список системных полей ресурса и ТВ-полей.

- Поле в источнике. Текстовое поле, в которое нужно ввести наименование тега в RSS-ленте.

Можно указать @INLINE чанк, который будет обработан Fenom из pdoTools. В чанке содержатся плейсхолдеры всех возможных полей из RSS-ленты, которые имеются в записи между тегами item, а также массив с настройками задания $_task.

За счёт внедрения в данное поле Fenom, можно будет, получая значение из тега category (как например в RSS Lenta.ru) делать выборку по базе ресурсов, в поисках ID аналогичной категории на нашем сайте, а если не найдено — добавлять.

Тег enclosure и ему подобные, указываются либо через чанк: «@INLINE {$enclosure['url']}», либо в виде CSS селектора: «enclosure[url]».

Если не указано или значение по данному полю в ленте пустое, то в качестве значения для Системное поле будет взято значение из следующего поля — Значение по-умолчанию.

- Значение по-умолчанию. В данном поле можно указать значение, которое будет записано в Системное поле. Например, если мы в Системное поле выбрали class_key, то, чтобы создавались Тикеты, мы в поле Значение по-умолчанию пишем «Ticket», а Поле в источнике оставляем пустым.

Такую же «магию» можно сделать и с полем published, указав в значении по-умолчанию цифру «1». Тогда ресурс на сайт будет добавляться сразу опубликованным.

Помимо основых полей с данными, которые необходимо выгрузить на сайт, нам надо ещё добавить поле, по которому пакет будет понимать, что данная запись уже есть на сайте. Для этого добавляем новое поле, значение Системное поле оставляем пустым, а в Поле в источнике пишем, например, «guid» (потому что он менее всего подвержен изменениям). Должно быть как-то так:

Сохраняем. В списке полей на этом поле ставим указатель Уникальное поле (кнопка со звездой слева):

Всё готово к парсингу, как к единоразовому, так и к ежеминутному (у компонента есть скрипт для запуска заданий из крона).

Спасибо Владимиру за спонсорскую поддержку!

P.S. Владимиру этим компонентом, даже, как-то удавалось запускать импорт из WordPress в MODX. Надеюсь, он нам расскажет, как это сделать.

А теперь о развитии

1990 рублей — это не окончательная стоимость компонента, по мере развития стоимость будет только повышаться.Готово!Компонент будет расширяться до парсера HTML контента.Готово!Есть идея совмещения типов парсера (RSS лент и HTML контента). К примеру, в RSS лентах всегда присутствует ссылка на полную статью. В планах сделать так, чтобы воспользовавшись этим полем со ссылкой, передавать задание парсинга из RSS ленты в соседнее задание, которое настроено именно на этот HTML контент. Естественно, данная идея будет реализована только после того, как реализуется сам тип заданий «HTML контент».Готово!- Будет внедрена поддержка ms2Gallery, UserFiles2, modClassVar. Что ещё?

- Если есть интересные идеи развития компонента — высказывайтесь.

Купить дополнение в modstore.pro

Поблагодарить автора

Отправить деньги

Комментарии: 94

Интересна агрегация и публикация HTML контента по ключевым фразам из выдачи Яндекса и Гугл.

Например, мне нужен документ на сайте с заголовком (ключевой фразой) «Парсеры RSS лент», а xParser его автоматически создаст из результатов выдачи посковиков.

Например, мне нужен документ на сайте с заголовком (ключевой фразой) «Парсеры RSS лент», а xParser его автоматически создаст из результатов выдачи посковиков.

Для начала подойдет сбор RSS лент по ключевой фразе в задании. Одна фраза на один документ с rss подборкой.

Опишите подробнее.

К примеру, мне нужен ресурс на сайте с заголовком (ключевой фразой) «Как Трамп изменил жене с Хиллари», а xParser автоматически создаст и опубликует подборку из rss лент, в которых ключевая фраза встречается.

Извини, на секунду влезу в ваш диалог,

xParser автоматически создаст и опубликует подборку из rss лент— парсер 1. ищет сайты по теме, 2. ищет ленты на сайтах, 3. создает задания на парсинг, 4. публикует… так?

Получается так.

В первом пункте можно в ручную задать тематику сайтов для поиска «Политика». А еще лучше, чтобы парсер брал тематику из названия рубрики, в которой будет публиковать подборку.

В первом пункте можно в ручную задать тематику сайтов для поиска «Политика». А еще лучше, чтобы парсер брал тематику из названия рубрики, в которой будет публиковать подборку.

В общем, нужен автоматический генератор и публикатор текстов по заданной фразе…

Надоело платить тупым копирайтерами за тексты, которые приходится почти полностью переписывать. Лучше я один раз заплачу тебе и буду редактировать тексты от парсера.

P.S. — не тупые копирайтеры мне пока не по карману

Надоело платить тупым копирайтерами за тексты, которые приходится почти полностью переписывать. Лучше я один раз заплачу тебе и буду редактировать тексты от парсера.

P.S. — не тупые копирайтеры мне пока не по карману

Вот замечательная статья о том, как выжимать из копирайтеров все соки. Не нужно платить много денег. Нужно ставить четкие и определенные рамки.

По поводу пожелания, то вряд ли такое будет реализовано, по крайней мере в ближайшем будущем. Это всё же парсер, а не ИИ какой-то. :)

По поводу пожелания, то вряд ли такое будет реализовано, по крайней мере в ближайшем будущем. Это всё же парсер, а не ИИ какой-то. :)

Как-то так youtu.be/yQF0qhARbSw

Имеется ввиду, что надо сделать экранирование MODX тегов в тексте, полученном из RSS ленты?

Угу

Хотелось бы парсинг json/xml

XML есть итак, ибо RSS = XML. JSON будет.

Тогда скидок хотим)

Думаю, что modstore не станет изменять традициям и под Новый Год скидки будут, как и в прошлом году. :)

А он совместим с MiniShop? Можно ли при парсинге создавать товары?

Можно.

Павел, интересен такой функционал. Есть ссылка на XML выгрузку поставщика. Можно ли парсером его разбирать, создавая при этом товары (это вы уже ответили), а в дальнейшем например запускать парсинг раз в сутки и если товар уже есть, то просто сверять в нем поля, на изменения. Если товар в выгрузке новый и его нет еще на сайте, то создавать его, если товар удален в выгрузке, то на сайте ставить ему какой-либо статус (недоступен, под заказ ну или типа того).

Нет, такой функционал ещё не реализован. Редактирование уже существующих ресурсов вообще не предусмотрено. То, что вы описали, можно сделать по событию на плагин. Не очень много придётся дописывать в плагине… относительно не много… однако и возможности прикрутить свой плагин пока нет, ибо такой функционал пока не требовался ни одному пользователю пакета, но некоторые наработки в этом направлении уже есть.

Получается пока компонент не может обновлять данные в уже существующих ресурсах?

Да, обновлять не может.

Кто украл то?) На днях, как будто, было больше.

Забавно)) Я лично видел более 6ти точно. И минусов нет. Мистика!

Раз в 17 было больше вчера :)

домовой завелся)))))))

Поставил + и он показал рейт 19

Поставил + и он показал +20, обновил страницу — показывает +3 ))

Аналогично. После добавление +21, после обновления +4 :)

Супер!

такой компонент очевидный вклад в популяризацию MODX)

такой компонент очевидный вклад в популяризацию MODX)

[2016-12-02 14:55:31] (ERROR @ /var/www/www-root/data/www/mattera.guru/core/xpdo/om/xpdoobject.class.php : 240) Error 42S02 executing statement:

Array

(

[0] => 42S02

[1] => 1146

[2] => Table 'seofucktor.adv_xparser_tasks_rss' doesn't exist

)При установке выдавало ошибку

Could not create table `adv_xparser_tasks_rss` SQL: CREATE TABLE `adv_xparser_tasks_rss` (`id` INTEGER unsigned NOT NULL AUTO_INCREMENT, `task` INT(10) unsigned NULL DEFAULT '0', `url` VARCHAR(500) NOT NULL DEFAULT '', `tag_channel` VARCHAR(40) NOT NULL DEFAULT '', `tag_item` VARCHAR(40) NOT NULL DEFAULT '', PRIMARY KEY (`id`), INDEX `task` (`task`), INDEX `url` (`url`), INDEX `tag_channel` (`tag_channel`), INDEX `tag_item` (`tag_item`)) ENGINE=MyISAM ERROR: Array ( [0] => 42000 [1] => 1071 [2] => Specified key was too long; max key length is 1000 bytes )Подскажите как это можно исправить?

Пишите в поддержку на modstore. Заодно скидывайте доступ в админку. Очень похоже на ошибку MODX.

Отправил

Признаю, моя ошибка. Сначала не вник в то, что пишет MySQL. Оказалось, что он пишет о том, что в индексе указан слишком длинный ключ, а максимально допустимая длина — 1000 байт. И правда, у меня поле url — VARCHAR(500) было, следовательно это в UTF-8 — 1500 байт. Поправил.

Можно подробнее расписать про HTML парсинг?

Есть ли в нем возможность замены слов?

Есть ли в нем возможность замены слов?

HTML парсинг действительно готов и ждёт представления сообществу (времени мало на составление документации). В modstore компонент с этим механизмом уже доступен, пока в бета версии и по старой цене. Как только неделя скидок закончится — цена будет поднята, для начала до 3кр.

По замене слов: опишите подробнее, возможно, что получится решить исключительно средствами Fenom.

По замене слов: опишите подробнее, возможно, что получится решить исключительно средствами Fenom.

Возможно речь идет об уникализации контента синонимами, чтобы исключить явный копи-паст.

мне кажется цена была поднята еще до того, как неделя скидок закончилась, не?) я вчера собирался покупать и положил в корзину, а сегодня хочу оплатить, уже другая цена :(

Всё верно, стоимость уже подняли. Однако сейчас (сегодня) пока можно купить его почти по старой цене, т.к. ещё действует скидка 20%.

это очень досадно, так как все таки планировал по старой цене купить, был уверен, что цена будет держаться до конца недели скидок, как и вы ранее писали выше.

Павел, возможен ли в измеримом будущем парсинг HTML документов с сайтов без rss лент?

Оно уже есть, начиная с версии 1.1. Просто документацию пока не написал. На днях, на днях…

Подскажите, возможно ли парсить объявления с vladivostok.drom.ru/nissan/?

На первый взгляд — да.

отлично, вот еще такой вопрос — данные по объявлениям будут собираться только со списка автомобилей или можно цеплять больше информации? к примеру подробное описание и изображения vladivostok.drom.ru/nissan/liberty/24939035.html

Можно цеплять. О том, как настроить.

спасибо, пойду покупать.

Так, стоп. Вам возможно потребуется обход по страницам. Сейчас этого пока не реализовано. Однако добавив, например, первую страницу (или несколько, от 1 до 5, к примеру) можно постоянно выхватывать новые объявления.

А обход по страницам уже появился?

Добрый день, а можно ли парсить и создавать не ресурсы, а новую строку в TV-поле тип ввода migx?

Это можно будет делать в одной из следующих версий. Только делаться это будет через небольшой плагин. Как скоро появится следующая версия с таким функционалом зависит от необходимости данного функционала пользователям компонента.

Спасибо, за ответ. Если клиент созреет на такой функционал, я вам напишу.

Ещё лет 5 назад были подобные грабберы новостные для DLE, конечно RSS это хорошо, но было бы ещё лучше, если бы компонент мог по списку ключевых слов ходить по выдачам разных поисковиков и тырить текста с картинками и остальным. Тоесть быть полноценным парсером, аля доргеном) Если бы сайты в итоге были бы самонаполняемыми, так сказать псевдо сдл'ами (сателитами), то очень бы облегчили жизнь веб мастерам, которые с этого зарабатывают. Для популяризации MODX давно бы уже что-то подобное написали.))) Я бы только всеми руками за был!

А самое главное — появится практическая выгода от парсинга. А на rss денег не заработаешь и ценность дополнения снижается.

на rss денег не заработаешь— уже зарабатываю :)

получается, что «не умею зарабатывать»:)

Ребят кто-то дайте отзыв по парсингу HTML? насколько все успешно работает? И как в плане удобства? а то задумался о покупке компонента

А как использовать предполагаешь?

ну если парсинг хтмл есть, то как парсер старого сайта. (тексты, картинки или хотябы ссылки на них). Если возможно с форматированием или без. Перенос структуры разделов сайта. Вот минимум, который я хотел бы получить покупая данный компонент.

Вордпресс я перенес, например, там есть экспорт в хтмл — этот тот же RSS

Этот минимум уже как 3 месяца доступен + еще ряд классных плюшек. :)

Благодаря использованию фенома, можно тянуть строго нужное, регулярками, просто реплейсом.

Короче, придется написать об опыте использования.

На одном сайте xParser — это агрегатор новостей, на другом обмен партнерскими материалами. Использование этого инструмента — вопрос предприимчивости, а может он уже многое.

Короче, придется написать об опыте использования.

На одном сайте xParser — это агрегатор новостей, на другом обмен партнерскими материалами. Использование этого инструмента — вопрос предприимчивости, а может он уже многое.

Спасибо за инициативу! А то самому просить, как-то не удобно…

Благодарю за ответы

Уважаемые, может кто-то поделиться / объяснить как примерно настроить парсинг HTML? Инструкций по этому функционалу я так понимаю пока нет

Благодарю, невнимательно посмотрел

Не смог ответить в ТП modstore, т.к. тикет стал в режим чтения. Видимо из-за новой версии сайта.

Видимо так, сейчас я его даже увидеть не могу)

Можно ли с помощью данного компонента настроить парсинг группы ВК? Чтобы новые записи публиковались на сайте?

В целом — да, можно. Однако все зависит от требований к парсеру. Нужна ли поддержка «постраничности» в ВК, авторизация и т.п.

Я думаю, что пока достаточно из каждого поста в ВК создавать отдельную страницу в сайте, картинки парсить к примеру в TV или в Галерею, ну и текст в содержимое. Если я куплю компонент, в рамках ТП вы поможете настроить его?

Однако все зависит от требований к парсеру. Нужна ли поддержка «постраничности» в ВК, авторизация и т.п.Если оба пункта «нет», то помогу.

Можно ли с помощью данного компонента сделать парсинг данных (например новостей из разных источников), но сохранять их не в таблицу site_content, а в свою отдельную таблицу, чтобы не перегружать таблицу с ресурсами?

Не совсем понятно как реализуется сохранение изображений. И как передавать поля с несколькими значениями. Пытался записать массивом в список с автодополнением minishop2 не получается

И как передавать поля с несколькими значениями.Надо передавать в JSON. Читайте вот тут.

P.S. С ужасом понял, что в docs.modx.pro про работу с ms2 ни слова… Исправим!

Это самописный парсер или используется библиотека для парсинга html?

Для разбора документа по CSS или xPath селектору используется DomCrawler.

Здравствуйте, скажите с помощью вашего парсера могу ли я парсить дизайн страницы (например все что в определенном div блоке, с заданным id), после чего вставлять их в свои чанки, и также сохранять css файл к себе? Если да, то могу ли я задать частоту обновления парсинга и/или делать это в ручном режиме?

Нет, думаю такое не сделать с xParser. Тут нужно писать кастомное решение.

Подскажите пожалуйста, это расширение подойдет под мою цель — которая схожа с функционалом сохранения ссылок страниц — pocket, но только на своем сайте help.getpocket.com/

Если по действиям, то примерно так:

1) нахожу какую то интересную статью (на рус или англ м.б.)

2) копирую ссылку

3) создаю тикет ( у меня сайт на тикетах и феном)

4) тикету даю на вход эту ссылку

5) тикет берт Оглавнение, Описание и сам контент (может даже не весь)

Если по действиям, то примерно так:

1) нахожу какую то интересную статью (на рус или англ м.б.)

2) копирую ссылку

3) создаю тикет ( у меня сайт на тикетах и феном)

4) тикету даю на вход эту ссылку

5) тикет берт Оглавнение, Описание и сам контент (может даже не весь)

Нет.

Можете показать пример живого сайта где применен этот парсер, например сайт новостной или т.п.?

Обновление из источника можно реализовать? По какому-то признаку, например TV или артикул.

Здравствуйте! Возможна ли интеграция с msOptionsPrice2 modstore.pro/packages/ecommerce/msoptionsprice2?

Добрый день!

Интересует парсер товаров для modx на подобие модуля «Автоматическая обработка прайслистов» для opencart. Принцип его работы заключается в следующем.

Есть прайс, к примеру, на 500 товаров в excel. Я к каждому товару нахожу ссылку откуда парсить данные (т.е. с другого сайта, который мне понравится, этот же товар). Как правило после обработки всего прайслиста на выходе получается определенное количество сайтов, с которых будем парсить данные. К примеру, 7 штук.

Далее в модуле создаются шаблоны на парсинг под каждый из найденных сайтов. Там мы вводим разметку для необходимых типов данных с этих самых сайтов, т.е. как начинается необходимое поле и как заканчивается. Под каждый найденный сайт свой шаблон. К примеру, заголовок: в поле «Начало» вводим , а в поле «Конец» — . Все что между данными тегами, заносится в заголовок. И так далее с остальными данными, будь то описание, атрибуты (характеристики), изображения, цена и т.п.

Таким образом можно достаточно быстро наполнить магазин товарами со всеми необходимыми данными.

Ссылка на видео с обзором от автора модуля: www.youtube.com/watch?v=aCaoSaS3JC8&list=PLkDV_NaX_cBAerpeAke8cdw1Weom6jov_&index=10

Вопрос. Может ли данный парсер делать то же самое?

Спасибо!

Интересует парсер товаров для modx на подобие модуля «Автоматическая обработка прайслистов» для opencart. Принцип его работы заключается в следующем.

Есть прайс, к примеру, на 500 товаров в excel. Я к каждому товару нахожу ссылку откуда парсить данные (т.е. с другого сайта, который мне понравится, этот же товар). Как правило после обработки всего прайслиста на выходе получается определенное количество сайтов, с которых будем парсить данные. К примеру, 7 штук.

Далее в модуле создаются шаблоны на парсинг под каждый из найденных сайтов. Там мы вводим разметку для необходимых типов данных с этих самых сайтов, т.е. как начинается необходимое поле и как заканчивается. Под каждый найденный сайт свой шаблон. К примеру, заголовок: в поле «Начало» вводим , а в поле «Конец» — . Все что между данными тегами, заносится в заголовок. И так далее с остальными данными, будь то описание, атрибуты (характеристики), изображения, цена и т.п.

Таким образом можно достаточно быстро наполнить магазин товарами со всеми необходимыми данными.

Ссылка на видео с обзором от автора модуля: www.youtube.com/watch?v=aCaoSaS3JC8&list=PLkDV_NaX_cBAerpeAke8cdw1Weom6jov_&index=10

Вопрос. Может ли данный парсер делать то же самое?

Спасибо!

Такие вещи обычно обсуждают. Не благодари.

Я не разработчик. Личое от вас получил.

Подскажите. пожалуйста, кто знает как реализовать такую задачу, которую описал в комментарии. Кто как наполняет товарами магаз? Не вручную ж лопатить несколько тысяч…

Добавь плиз в доку, как парсить каталог с категориями вложенными?

Всем привет! А кто нибудь пробовал спарсить Алиэкспресс? Чет у меня не получается. Настраиваю, добавляю источник (link), нажимаю на глазик (для проверки) и получаю «вечную» загрузку. Подскажите, можно ли парсить товары с Али?

Позволяет ли компонент обрабатывать данные перед публикацией, к примеру через дополнительный сниппет с API переводчика?

Через плагины, как вариант. Либо через Fenom + сниппет.

Вот подскажите

Есть у меня к примеру xml

вот кусок

Но как его записать в «поле источника» что бы оно тянуло верно в minishop2|categories?

Есть у меня к примеру xml

вот кусок

<code>24175</code>

<vendor>(Пигас)</vendor>

<name>Футболка S-L Happiness 24175</name>Но как его записать в «поле источника» что бы оно тянуло верно в minishop2|categories?

Подскажите. В Родительский ресурс контейнер — подгружаются около 20 ресурсов — а нужные не подгружаются, поиск тоже не работает. Сохранить задание соответственно не получается.

file.modx.pro/files/e/4/9/e4945ce95acb1f355845fde2ab8eed8a.png

file.modx.pro/files/e/4/9/e4945ce95acb1f355845fde2ab8eed8a.png

Авторизуйтесь или зарегистрируйтесь, чтобы оставлять комментарии.